一个真实的顾虑:

你在做一个涉及玩家心理档案的独立游戏,NPC的记忆系统需要大模型来分析玩家的历史行为,生成个性化对话。但你不想把这些数据上传到OpenAI的服务器——玩家信息是敏感数据,上传意味着额外的隐私合规风险。

Ollama是这个问题的一个具体答案:让大模型跑在你开发机上,数据永不离开本地。

Ollama是什么

Ollama是一个让你在本地机器上运行大模型的工具。它把模型打包成统一的格式,一行命令即可运行,不需要懂CUDA配置、不需要手动下载权重文件。

支持1700+模型,包括Llama 3.3、DeepSeek-R1、Mistral、Qwen等主流开源模型。NVIDIA/AMD/Apple Silicon都能用GPU加速。

它的核心价值:没有API费用,没有使用限制,没有数据离开你的电脑。

独立游戏开发者能用它做什么

NPC对话生成与个性化。这是最直接的应用场景。让Ollama跑一个7B或13B的模型,根据玩家历史生成NPC的个性化回复。玩家数据不需要发给任何第三方。

import ollama

response = ollama.chat(

model='deepseek-r1:7b',

messages=[

{"role": "system", "content": "你是一个熟悉本地开发者工作的NPC,风格幽默简短"},

{"role": "user", "content": "玩家在过去3场战斗中使用了防御型装备,对话应该如何体现这个历史"}

]

)

print(response['message']['content'])

关卡描述和动态叙事。你的Roguelike游戏每次生成的关卡,可以通过Ollama生成描述文本——不是预设的文字,而是根据这一次实际生成的关卡布局和敌人组合,动态生成。

自动化测试与QA。写一个测试脚本,让Ollama模拟玩家行为,帮你跑一遍游戏流程,生成异常报告。这不是单元测试的替代,是额外的端到端探索。

文档和lore生成。让Ollama学习你的世界观文档,然后生成符合设定的对话内容。

硬件要求

| 模型 | 最低内存 | 推荐配置 | 能做什么 |

|---|---|---|---|

| 3B | 6GB | 8GB | 简短NPC对话 |

| 7B | 8GB | 16GB | 日常对话,基础叙事 |

| 13B | 16GB | 24GB | 复杂对话,质量接近GPT-4 |

| 70B | 64GB | 128GB | 最强输出,本地最强模型 |

Apple Silicon(M系列芯片)的内存和GPU统一,建议直接用M系列芯片的Mac——内存带宽足够,跑13B模型体验流畅。

NVIDIA显卡用户需要至少8GB显存才能有效加速。

快速上手:5分钟跑通第一个模型

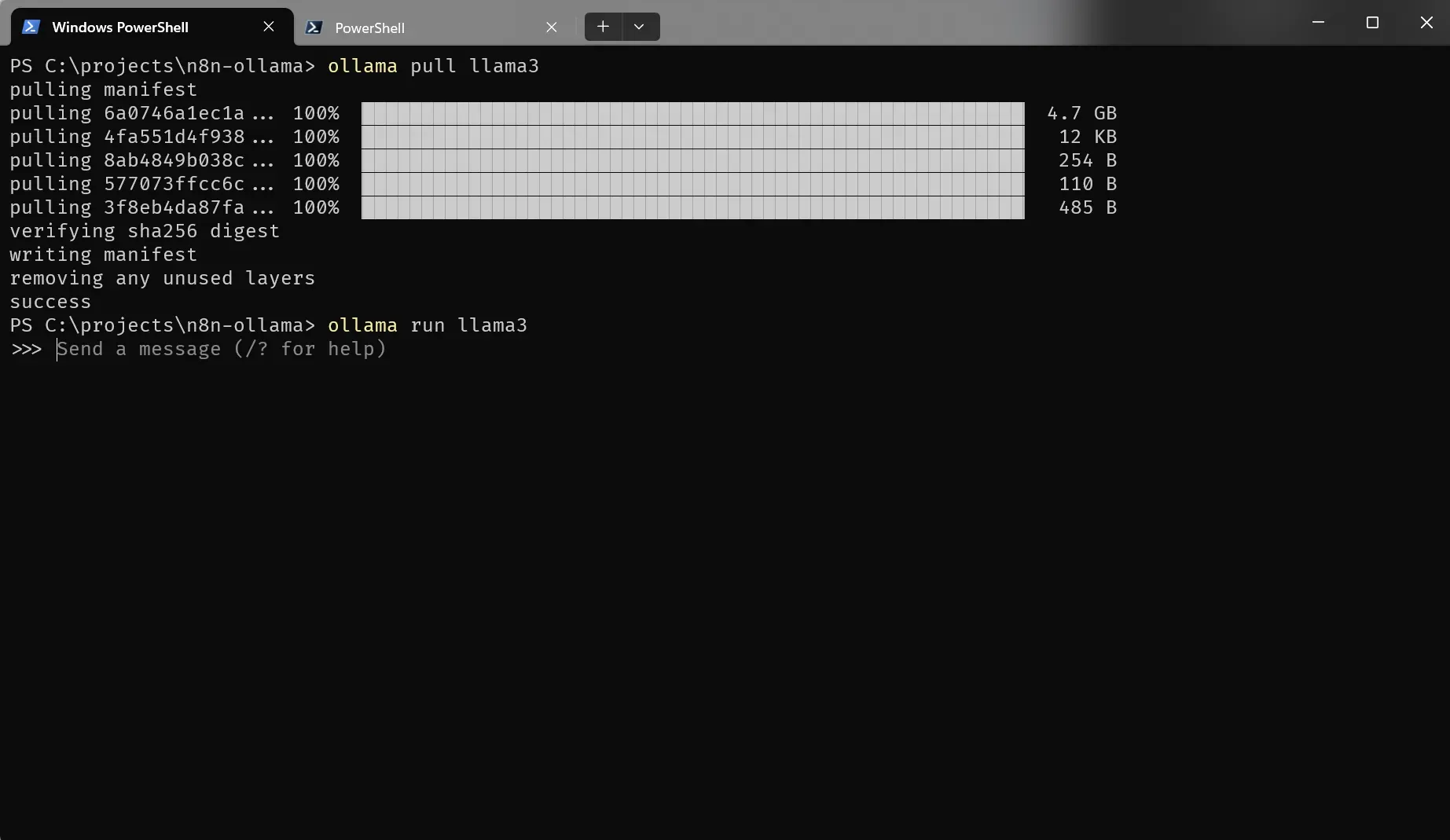

Step 1:安装Ollama。macOS用brew install ollama,Windows去ollama.com/download下载,Linux用官方安装脚本。

Step 2:下载你的第一个模型。7B的DeepSeek-R1大约4GB:

ollama pull deepseek-r1:7b

Step 3:运行模型。

ollama run deepseek-r1:7b

终端里直接对话,完全免费,不限次数。

Step 4:接入你的代码。用Python的ollama包:

pip install ollama

Step 5(可选):装OpenWebUI,获得图形界面。

docker run -d -p 3000:8080 ghcr.io/open-webui/open-webui:main

成本分析

Ollama本身完全免费。没有订阅,没有API费用。

唯一成本是你的电费。以13B模型为例,跑一个小时大约消耗0.2-0.5度电,折合人民币0.1-0.3元。对比OpenAI的GPT-4o Mini:100万token约$0.15,一个需要频繁调用AI的独立游戏项目,每月API费用从几十到几百不等,本地运行的电费可以忽略不计。

它的局限

模型质量有差距。本地7B/13B模型的输出质量,大约相当于GPT-3.5到GPT-4之间。如果你的场景需要最顶级的生成质量,本地模型的输出需要人工review再进游戏。

不是所有人的机型都能跑。没有独立显卡的Windows PC跑起来很吃力,建议用Mac或配了NVIDIA显卡的工作站。

更新模型需要手动。云端API会自动用到最新版本,本地模型需要你主动ollama pull来更新。

和其他工具的组合

Ollama最适合和n8n搭配:Ollama提供本地AI能力,n8n处理工作流自动化。Ollama + 结构化提示词模板 + 版本控制的历史对话记录,组合起来是一个完整的不依赖第三方的游戏AI叙事系统。

参考资源

Xmohe Techie:n8n工作流自动化入门:用开源工具连接你的游戏开发管线

- Ollama官网(下载和文档)

- Ollama模型库(1700+模型)

- OpenWebUI(图形界面)(可选的本地Web界面)

- DeepSeek-R1实操指南